Saúde

Inteligência artificial avança no diagnóstico médico, mas ainda erra como humanos — e acerta mais quando trabalha com eles

Estudo internacional com mais de 4 mil casos clínicos revela limites dos modelos de linguagem e aponta colaboração homem-máquina como caminho mais promissor na medicina

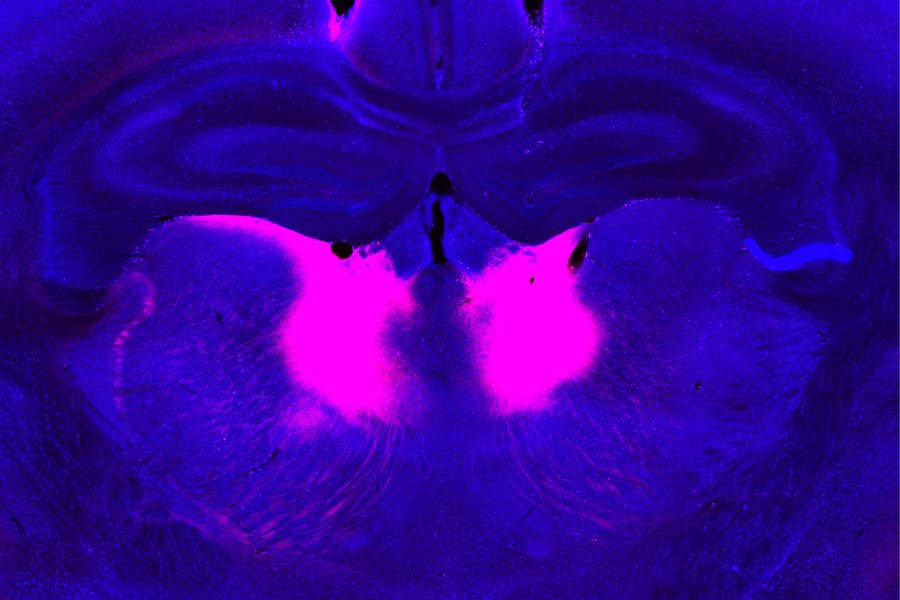

Imagem: Reprodução

O diagnóstico médico, por anos, foi considerado um dos atos mais complexos da prática clínica — uma combinação de conhecimento técnico, raciocínio probabilístico e experiência acumulada. Agora, um estudo publicado nesta quarta-feira (25), na revista Nature Communications, coloca a inteligência artificial no centro desse processo — e revela tanto seu potencial quanto suas fragilidades.

A pesquisa, liderada por Xi Chen e colegas da Universidade de Sichuan, com colaboração de instituições como a Universidade Carnegie Mellon e a Universidade Emory, desenvolveu um modelo especializado chamado ClinDiag-GPT, projetado para simular o raciocínio clínico passo a passo. Diferentemente dos testes tradicionais, que avaliam respostas prontas, o estudo buscou reproduzir o ambiente real de atendimento médico, em que informações surgem de forma gradual e decisões precisam ser constantemente revisadas.

“Os modelos atuais demonstram amplo conhecimento médico, mas falham em reproduzir o processo iterativo da prática clínica”, afirmam os autores.

Da teoria à prática: o desafio do mundo real

O trabalho analisou 4.421 casos clínicos reais, distribuídos em 32 especialidades médicas, incluindo situações de emergência e doenças raras. Ao comparar diferentes modelos de linguagem — incluindo versões comerciais amplamente utilizadas — os pesquisadores identificaram um padrão consistente: o desempenho cai drasticamente quando a tarefa exige raciocínio sequencial.

Nos testes mais simples, com todas as informações disponíveis desde o início, a taxa de acerto variou entre 57% e 61%. Já em cenários mais realistas, nos quais o sistema precisa “investigar” o paciente, a precisão despencou para uma faixa entre 29% e 39%.

A diferença evidencia um ponto crítico: saber medicina não é o mesmo que praticá-la.

“O diagnóstico clínico é um processo dinâmico, que exige coleta ativa de informações e revisão constante de hipóteses”, destacam os pesquisadores.

Erros humanos — agora também digitais

A análise detalhada revelou que os modelos cometem erros semelhantes aos de médicos humanos, incluindo vieses cognitivos clássicos. Entre eles, o chamado “viés de ancoragem” — quando o diagnóstico inicial influencia excessivamente a decisão final — e o “viés de confirmação”, que leva à ignorância de evidências contrárias.

No estudo, a taxa de viés de ancoragem chegou a mais de 50% em alguns modelos, enquanto o ClinDiag-GPT conseguiu reduzir esse índice para cerca de 32%.

Além disso, entre 45% e 68% dos erros ocorreram mesmo quando o sistema tinha informações suficientes — ou seja, falhas de raciocínio, não de dados.

“Isso mostra que o desafio não é apenas coletar informações, mas interpretá-las corretamente”, escrevem os autores.

O modelo que aprende como médico

Para enfrentar essas limitações, os cientistas treinaram o ClinDiag-GPT com mais de 7.600 casos reais, estruturados como diálogos clínicos — simulando interações entre médico e paciente. O objetivo foi ensinar o modelo a pensar em etapas: levantar hipóteses, solicitar exames, interpretar resultados e só então concluir.

O resultado foi um ganho consistente de desempenho em cenários complexos. O modelo superou todos os concorrentes em precisão diagnóstica no ambiente simulado e apresentou menor taxa de erro em todas as etapas do processo clínico.

Imagem: Reprodução

Ainda assim, os próprios autores reconhecem limites importantes. Mesmo o modelo mais avançado não ultrapassou 40% de acerto em cenários realistas — um patamar considerado insuficiente para uso autônomo.

A força da colaboração

O dado mais relevante do estudo, no entanto, surge quando humanos e máquinas trabalham juntos. Em um experimento com médicos reais, a combinação entre profissional e inteligência artificial atingiu 45% de acerto — superando tanto os médicos sozinhos (40%) quanto o modelo isolado (23%).

Além disso, o tempo médio para diagnóstico caiu de 22 minutos (médicos sozinhos) para cerca de 15 minutos na colaboração com IA.

“Os resultados demonstram que a colaboração melhora tanto a eficiência quanto a precisão diagnóstica”, concluem os autores.

O avanço ocorre em um contexto de crescente pressão sobre sistemas de saúde, envelhecimento populacional e escassez de profissionais especializados — especialmente em regiões periféricas e países em desenvolvimento.

Apesar do entusiasmo, os pesquisadores alertam para o risco de confiança excessiva. Os modelos tendem a ser “excessivamente confiantes”, mesmo quando erram, o que pode induzir decisões equivocadas.

A recomendação é clara: a inteligência artificial deve atuar como ferramenta de apoio, não como substituta do médico.

Um novo paradigma na medicina

Historicamente, a medicina incorporou tecnologias que ampliaram a capacidade diagnóstica — do estetoscópio à tomografia computadorizada. A inteligência artificial surge agora como uma nova camada, capaz de integrar dados, sugerir caminhos e acelerar decisões.

Mas, como mostra o estudo, o raciocínio clínico ainda não pode ser totalmente automatizado.

O futuro, ao que tudo indica, será híbrido: médicos apoiados por algoritmos — e algoritmos supervisionados por médicos.

“Esses sistemas devem ser vistos como assistentes clínicos”, afirmam os autores. “Seu valor está em complementar, e não substituir, o julgamento humano.”

Referência

Chen, X., Zhou, H., Yi, H. et al. Fundamentação de grandes modelos de linguagem em diagnósticos clínicos. Nat Commun (2026). https://doi.org/10.1038/s41467-026-70274-w